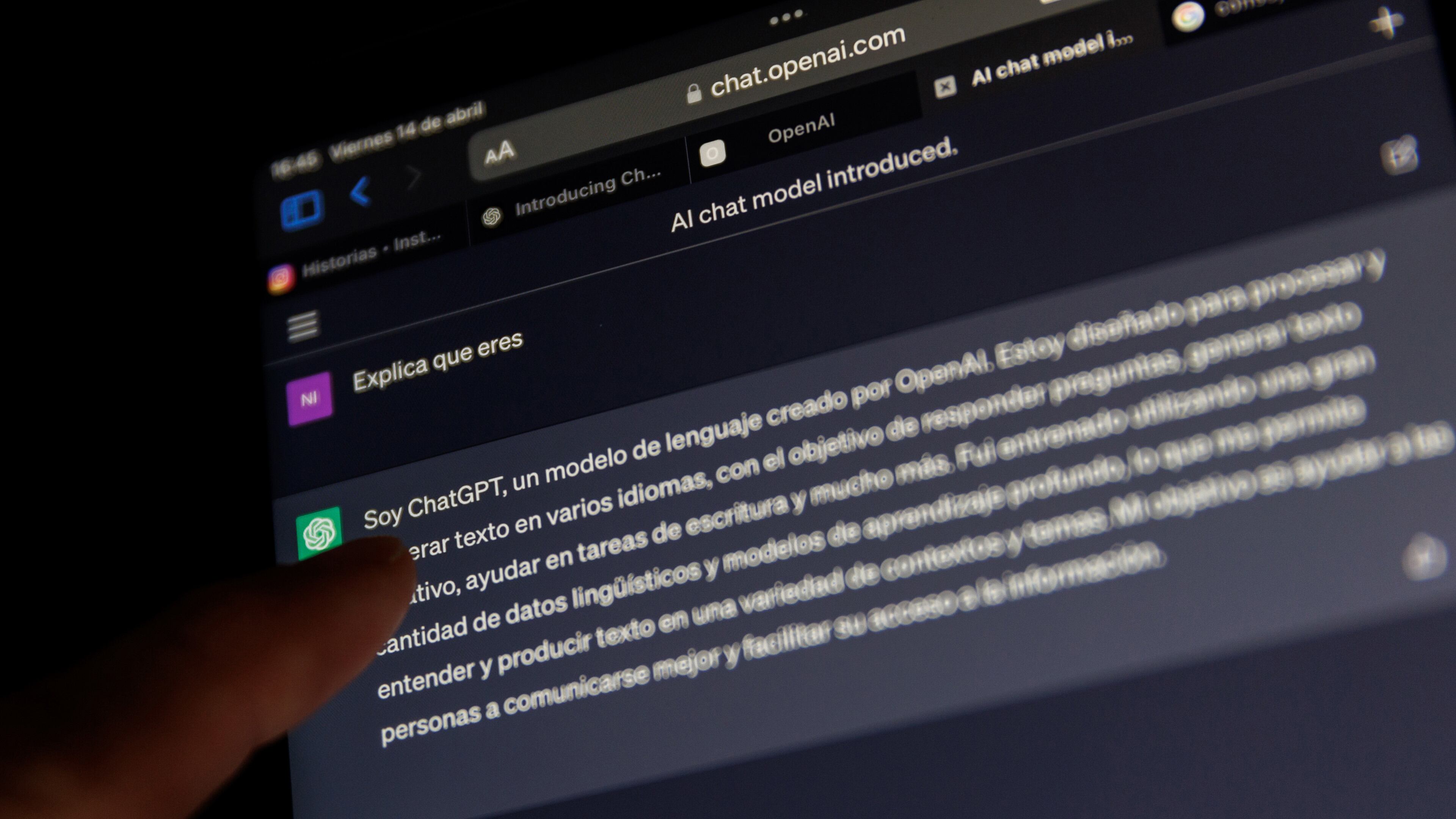

¡De no creer! Un abogado está en apuros por usar la respuesta que le dio ChatGPT en un caso contra Avianca.

El estadounidense se enfrenta a posibles sanciones después de haber usado esta popular herramienta basada en la Inteligencia Artificial para redactar un escrito. Lo que no sabía es que el programa no dice siempre la verdad y se inventó toda una serie de supuestos precedentes legales.

Según publicó el diario The New York Times, el abogado en problemas es Steven Schwartz, abogado de un caso que se dirime en un tribunal de Nueva York, una demanda contra la aerolínea Avianca presentada por un pasajero que asegura que sufrió una lesión al ser golpeado con un carrito de servicio durante un vuelo.

Schwartz representa al demandante y utilizó ChatGPT para elaborar un escrito en el que se oponía a una solicitud de la defensa para que el caso fuese desestimado.

También le puede interesar: Inteligencia Artificial: Estos son los países que tienen prohibido el uso del ChatGPT

En el documento de diez páginas el abogado citaba varias decisiones judiciales para apoyar sus tesis, pero no tardó en descubrirse que el conocido chatbot de la compañía OpenAI se las había inventado.

“La Corte se encuentra ante una situación inédita. Una presentación remitida por el abogado del demandante en oposición a una moción para desestimar (el caso) está repleta de citas de casos inexistentes”, escribió el juez Kevin Castel.

Luego, el juez emitió una orden convocando a una audiencia el próximo 8 de junio en la que Schwartz deberá tratar de explicar por qué no debería ser sancionado después de haber tratado de usar supuestos precedentes totalmente falsos.

Lo hizo un día después de que el propio abogado presentara una declaración jurada en la que admitió haber usado ChatGPT para preparar el escrito y reconoció que la única verificación que había llevado a cabo era preguntar a la aplicación si los casos que citaba eran reales.

Schwartz se justificó asegurando que nunca antes había usado una herramienta de este tipo y que, por tanto, “no era consciente de la posibilidad de que su contenido pudiese ser falso”.